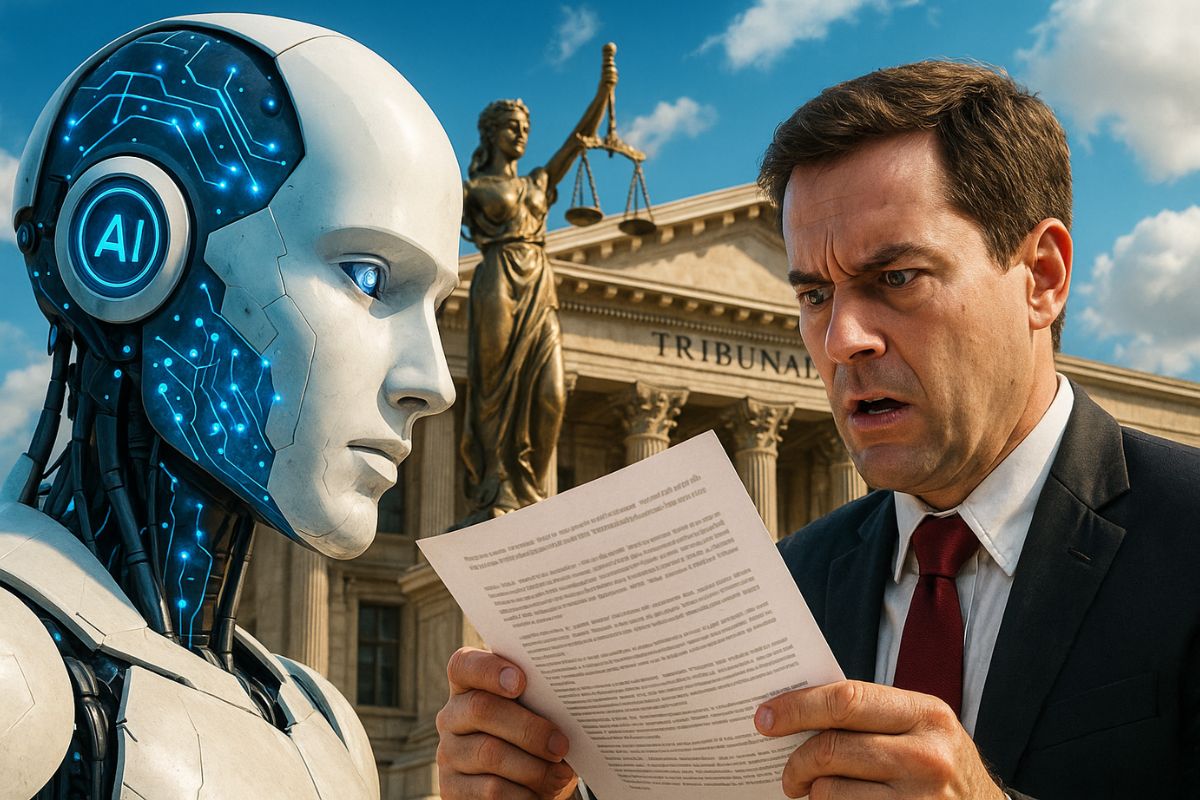

Tribunal da Califórnia aplicou multa de US$ 10 mil após detectar petição com citações falsas criadas pelo ChatGPT.

Um caso inédito expôs os riscos do uso da inteligência artificial no Direito. O Tribunal de Recursos do 2º Distrito da Califórnia multou em US$ 10 mil o advogado Amir Mostafavi, que apresentou uma petição recheada de citações jurídicas falsas produzidas pelo ChatGPT.

Segundo o Conjur, 21 das 23 referências incluídas no documento eram fabricadas, o que levou a corte a transformar o processo em exemplo para todo o sistema judicial.

A decisão foi publicada mesmo em circunstâncias que normalmente não justificariam divulgação, justamente para advertir advogados e juízes sobre os perigos da confiança cega em ferramentas de IA.

-

Câmara aprova projeto que libera spray de pimenta para mulheres acima de 16 anos e impõe regras rigorosas para compra, posse e uso como defesa pessoal

-

Câmara aprova lei para combater leucena, planta que cresce rápido, domina terrenos e ameaça espécies nativas em várias regiões do país

-

Partilha de bens: saiba o que não pode ser dividido em caso de separação

-

Funcionário de banco cria conta online em nome de cliente que havia morrido meses antes, desvia mais de R$ 385 mil em transferências eletrônicas e acaba condenado a 15 anos de prisão em San Salvador após descoberta do esquema iniciado em agosto de 2021

O caso que acendeu o alerta

A petição de Mostafavi chamou atenção porque incluía precedentes inexistentes ou incorretos.

O tribunal destacou que as chamadas “alucinações” da IA respostas que parecem plausíveis, mas não correspondem à realidade criaram jurisprudências que simplesmente não existiam.

A corte foi categórica: o advogado falhou ao não checar o conteúdo produzido pela ferramenta.

Para os juízes, não há nada de errado em usar tecnologia no processo jurídico, mas o dever de verificação é exclusivo do profissional.

Sanções e efeito pedagógico

Além da multa de US$ 10 mil, o tribunal determinou que Mostafavi entregasse cópias da decisão a seu cliente e à seccional da American Bar Association na Califórnia.

O objetivo é ampliar a discussão sobre ética profissional e produzir guias de conduta voltados ao uso responsável da IA no Direito.

De acordo com o Conjur, o colegiado de três juízes deixou claro que a punição serve como advertência para toda a comunidade jurídica.

A publicação da decisão foi considerada necessária diante do aumento exponencial de casos semelhantes nos tribunais norte-americanos.

Problema em crescimento

Estudos recentes apontam que até três em cada quatro advogados já utilizam ferramentas de IA generativa no trabalho.

O problema é que, em cerca de um terço das situações, os modelos acabam apresentando informações falsas ou distorcidas.

Pesquisadores como Damien Charlotin e Nicholas Sanctis afirmam que o número de casos desse tipo vem crescendo mês a mês.

Se antes eram registradas poucas ocorrências esporádicas, hoje os relatos chegam a dezenas por semana, em diferentes áreas do Judiciário.

O impacto para a Justiça

O tribunal ressaltou que ações frívolas oneram todo o sistema, desviando tempo e recursos que poderiam ser dedicados a litígios legítimos.

A decisão também chamou atenção para os contribuintes, que acabam arcando com custos adicionais quando a Justiça precisa revisar e investigar petições baseadas em falsidades.

Especialistas afirmam que a tendência é de agravamento no curto prazo. Muitos modelos de linguagem priorizam dar respostas, mesmo quando não possuem dados confiáveis, o que aumenta a probabilidade de erros.

Limites da tecnologia no Direito

Apesar dos riscos, a corte reconheceu que a inteligência artificial no Direito pode ser uma ferramenta útil, desde que usada com responsabilidade.

Para os juízes, não cabe à IA substituir o trabalho crítico dos advogados, mas apenas auxiliá-los em pesquisas e tarefas preliminares.

O recado é claro: tecnologia não elimina a necessidade de leitura atenta e checagem rigorosa.

Advogados que delegarem integralmente a elaboração de argumentos jurídicos às máquinas podem colocar em risco não apenas seus clientes, mas também a credibilidade da Justiça.

O caso de Amir Mostafavi mostra como a dependência cega da tecnologia pode trazer consequências graves, inclusive para profissionais experientes.

Ao mesmo tempo, reforça o debate sobre os limites e responsabilidades no uso da inteligência artificial no Direito.

E você, acredita que a IA deve ter espaço maior no sistema judicial ou que seu uso precisa ser restrito para evitar abusos?

Deixe sua opinião nos comentários queremos ouvir sua análise sobre esse desafio ético e tecnológico.

Minha PETIÇÃO acabou de subir ao Conselho Nacional de Justiça – CNJ com o uso escancarado da AI, pois a tecnologia deve estar ao nosso serviço, inclusive o(a) ADVOGADO(A) deve falar na própria petição sobre o uso da AI, pois esta atitude demonstra superioridade à qualquer máquina!!! Nós nos tornamos superiores quando colocamos a AI no patamar de serviçal da humanidade

Link da PETIÇÃO: https://drive.google.com/file/d/1LBeMbDADyRBXl9i5nUPmBI7lUDMdQkuV/view?usp=drivesdk

Boa tarde, seu e-mail de cadastro de comentário aqui no blog é o que podemos entrar em contato para sabermos mais sobre a petição?

Eu entendo que a IA é somente uma auxiliar, não só na justiça, como em todas as outras profissões. Mas não pode passar disso. A responsabilidade final é do ser humano, o profissional. E deve haver sempre a checagem.