Descubra o que o ChatGPT não pode fazer no Brasil, incluindo limites legais, regras da LGPD, uso por menores de idade e possíveis formas de monitoramento.

O ChatGPT virou uma ferramenta cada vez mais presente na rotina de brasileiros. Hoje, muitas pessoas utilizam a inteligência artificial para esclarecer dúvidas, organizar informações e até receber apoio em diversas tarefas do dia a dia.

Apesar das vantagens, existem situações em que o ChatGPT não pode fazer no Brasil determinadas ações. Isso ocorre porque o uso da tecnologia precisa respeitar limites legais, técnicos e éticos que definem o que é permitido no país.

Essas regras envolvem desde o uso por menores de idade até questões relacionadas à privacidade de dados e possíveis formas de monitoramento de conteúdo.

-

Casio apresenta Moflin, pet robótico com inteligência artificial criado para oferecer conforto emocional e simular vínculo afetivo permanente

-

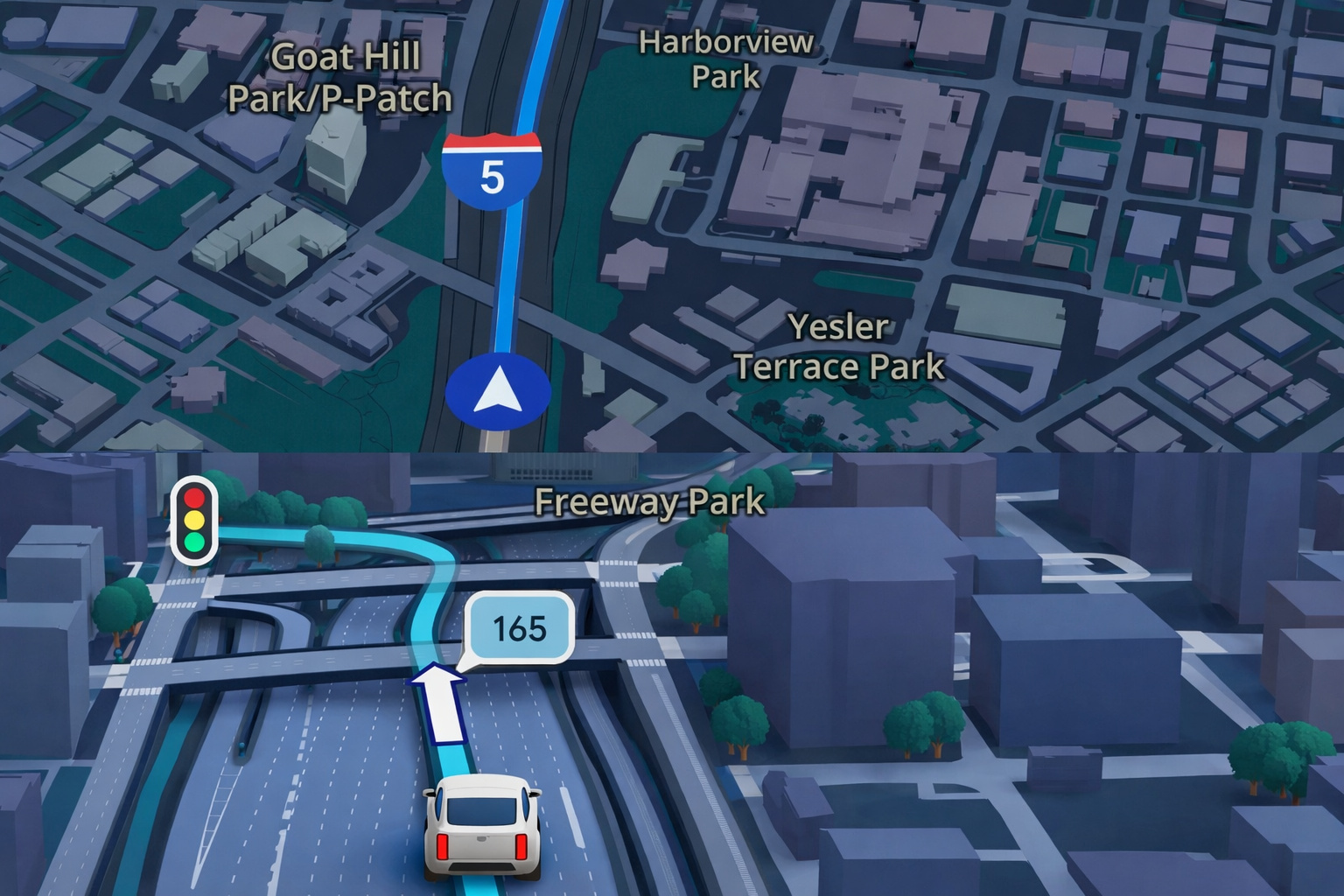

Google Maps revoluciona navegação por GPS com inteligência artificial Gemini, recurso Ask Maps e visualização 3D avançada para planejamento de rotas e viagens

-

China alerta os EUA para um apocalipse estilo “Exterminador do Futuro”: disputa por inteligência artificial militar, sanções contra startup americana e medo de algoritmos decidindo quem vive ou morre colocam o mundo diante de um pesadelo que parecia só ficção

-

UTCAL Summit 2026 no Rio discute cibersegurança com IA para proteger infraestruturas críticas e sistemas ciberfísicos

Portanto, entender esses limites ajuda usuários e empresas a utilizarem a ferramenta de forma mais segura.

Limites para menores de idade no uso do ChatGPT no Brasil

Uma das restrições envolve o acesso de crianças e adolescentes às plataformas de inteligência artificial.

A partir de 2026, brasileiros com menos de 14 anos precisam ter autorização dos pais ou passar por algum tipo de verificação de idade para utilizar ferramentas como o ChatGPT.

Essa exigência busca aumentar a proteção de menores no ambiente digital e evitar o acesso sem supervisão.

Dessa forma, plataformas podem restringir o uso direto por crianças e adolescentes.

Privacidade e dados sensíveis também definem o que o ChatGPT não pode fazer no Brasil

Outro ponto importante envolve a proteção de informações pessoais.

O ChatGPT não deve ser utilizado para processar dados bancários, informações pessoais sensíveis ou conteúdos sigilosos protegidos por lei.

Essa limitação está relacionada à Lei Geral de Proteção de Dados (LGPD), que estabelece regras para o tratamento de dados pessoais no Brasil.

Por isso, especialistas recomendam que empresas, órgãos públicos e usuários tenham cautela ao inserir informações confidenciais em ferramentas de inteligência artificial.

Monitoramento e regulamentação também afetam o uso do ChatGPT

Além das regras de privacidade, o uso da tecnologia também pode passar por mecanismos de monitoramento.

Conteúdos considerados graves ou ilegais podem ser analisados pelas plataformas e, em situações extremas, encaminhados às autoridades responsáveis.

Isso acontece porque o ChatGPT também precisa seguir normas previstas no Marco Civil da Internet, legislação que regula o funcionamento da rede no Brasil.

Além disso, especialistas apontam que novas regulamentações específicas para inteligência artificial podem surgir nos próximos anos.

Uso responsável da inteligência artificial é essencial

Mesmo com essas limitações, o ChatGPT continua sendo uma ferramenta útil para aprendizado, produtividade e organização de informações.

No entanto, compreender o que o ChatGPT não pode fazer no Brasil é fundamental para evitar problemas legais ou riscos relacionados à privacidade.

Assim, ao respeitar as regras e utilizar a tecnologia de forma consciente, usuários podem aproveitar melhor os benefícios da inteligência artificial no cotidiano.

Fonte: Exame

Seja o primeiro a reagir!